Expertise Contrôle Commande Industriel - SIS - Cybersécurité OT

La sécurité fonctionnelle est la clé de performance et de fiabilité des systèmes industriels. Découvrez comment les Systèmes Instrumentés de Sécurité (SIS) et l’évaluation SIL permettent de réduire les risques et d’assurer la conformité aux normes CEI 61508 et CEI 61511.

Explorez les guides et outils pour comprendre l’impact des architectures, des taux de défaillance et des tests périodiques sur la PFD ou PFH des fonctions de sécurité afin d’optimiser la sécurité de vos installations. [En savoir plus →]

La cybersécurité OT est essentielle pour protéger les systèmes industriels contre les attaques et les incidents qui peuvent compromettre la disponibilité, l’intégrité et la confidentialité. Nos ressources expliquent les bonnes pratiques pour sécuriser les Systèmes Instrumentés de Sécurité (SIS), les réseaux industriels et les automates.

Découvrez nos guides et outils pour anticiper les menaces et renforcer la résilience de vos installations. [En savoir plus →]

Les réseaux industriels et bus de terrain sont la colonne vertébrale des systèmes de Contrôle-Commande Industriel (CCI). Une communication fiable et sécurisée permet d’assurer la continuité des opérations et l’intégrité des données.

Explorez nos ressources sur les protocoles, architectures réseau et bonnes pratiques pour optimiser et sécuriser vos infrastructures industrielles. [En savoir plus →]

L’automatisation et instrumentation des machines et des procédés est au cœur de la performance industrielle et de la cybersécurité OT. Comprendre les automatismes, leur programmation, réaliser les analyses fonctionnelles et organiques, vérifier et valider leur performance et intégration. permet d’améliorer l’efficacité et la sécurité des installations.

Consultez nos guides et outils pour maîtriser les automatismes et leur rôle dans les systèmes industriels modernes.

Règlement Machine & Cybersécurité

Le Règlement (UE) 2023/1230, adopté en juin 2023 et applicable dès janvier 2027, remplacera la Directive 2006/42/CE. Son objectif est d’intégrer de nouvelles exigences de sécurité, notamment face aux évolutions des risques liés à la cybersécurité.

Avec la généralisation des machines connectées et la convergence des technologies IT, les cyberattaques des systèmes opérationnels représentent une menace majeure. Le règlement impose donc aux fabricants d’intégrer dès la conception des protections contre ces risques, de gérer les vulnérabilités et d’appliquer des règles d’hygiène informatique tout au long du cycle de vie des machines, y compris lors des mises à jour logicielles.

La protection contre la corruption fait partie intégrante des exigences essentielles de santé et sécurité (annexe III – 1.1.9). La machine doit pouvoir résister aux contraintes d’exploitation prévues et aux influences extérieures volontaires et involontaires.

Le Règlement (UE) 2024/2847 dit Cyber Resilience Act (CRA), la Directive (UE) 2022/2555 dite NIS 2 « Network and Information System Security » et la Directive 2014/53/UE dite RED « Radio Equipment Directive » viennent compléter le Règlement (UE) 2023/1230 relatif aux machines.

Tous poursuivent le même objectif : renforcer la cybersécurité. Le CRA établit des règles minimales de sécurité pour les produits numériques (matériels et logiciels), permettant aux fabricants de mieux gérer et communiquer les vulnérabilités. La directive NIS 2 impose des obligations de cybersécurité aux opérateurs de secteurs essentiels, avec des impacts directs ou indirects pour les fabricants de machines. Enfin, la directive RED encadre les équipements radioélectriques afin d’éviter les perturbations des réseaux publics. Ensemble, ces textes posent un cadre cohérent pour des machines plus sûres face aux cybermenaces.

Dans le cadre de l’application du Règlement Machines, la série IEC 62443 constitue une référence utile pour traiter les exigences de cybersécurité applicables aux systèmes d’automatisation et de contrôle industriels (IACS). Norme internationale de référence, elle inspire les normes de type B et C et est également prise en compte dans d’autres textes, tels que l’IEC/TS 63074 (sécurité fonctionnelle, IEC 61508) et le projet EN 50742 (protection contre la corruption des machines).

Sécurité Machine Vs Sécurité des Procédés

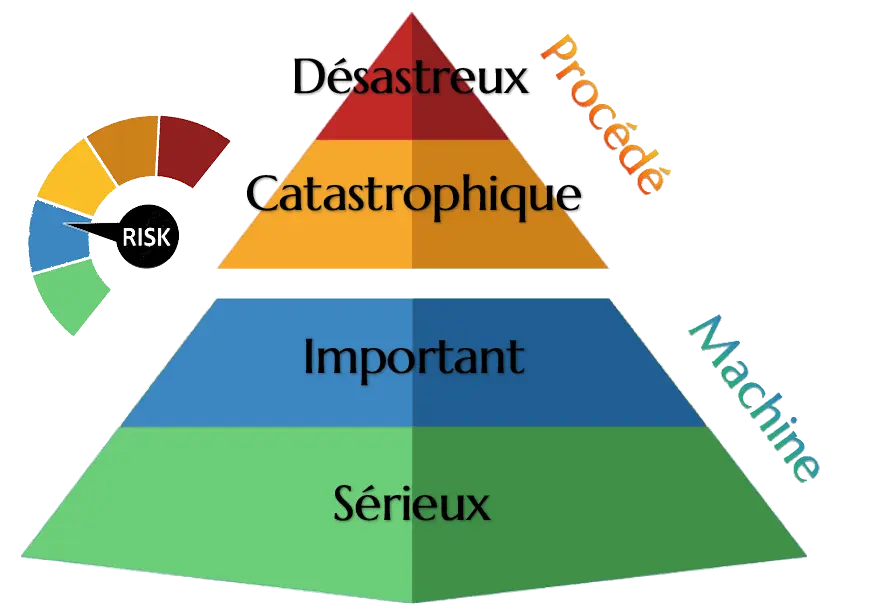

La sécurité des machines et la sécurité des procédés industriels sont généralement traitées séparément. Elles sont régies par des normes, des approches, des risques et des domaines industriels différents, ce qui conduit souvent à une gestion distincte. Cette dichotomie est devenue une évidence dans le domaine industriel. La sécurité machine se concentre principalement sur la protection des travailleurs et est régie par le code du travail, tandis que la sécurité des procédés se concentre davantage sur la préservation de l’environnement et est réglementée par le code de l’environnement.

Cette division semblait donc logique et plus facile à gérer. Elle correspond à une distinction entre les risques de sécurité traditionnels, entraînant des événements à fréquence relativement élevée et à faibles conséquences (par exemple, les chutes et les glissades), et les risques majeurs, associés à des événements rares mais aux conséquences graves (comme les explosions ou les rejets de produits toxiques). On retrouve ces distinctions dans les modes de fonctionnement des chaines de sécurité. Elles sont majoritairement à faible sollicitation dans le secteur des procédés et à forte sollicitation ou continu dans le secteur des machine, la faible sollicitation étant carrément exclue dans l’ISO 13849.

- Vu leur différences, cette distinction est-elle judicieuse ?

- Ces approches sont-elles en conflit ou se complètent elles ?

- L’accent mis sur l’une des sécurités conduit il à la négligence de l’autre ?

- Quel référentiels normatif appliquer ?

- Comment traiter un risque machine intégrée dans un procédé ?

- Quid des combinaison de fonctions qui ne sont pas rattachés à une même appréciation du risque ?

- Quel impact peut avoir la modification d’une machine pour répondre à une sécurité procédé ?

Nonobstant des réponses apportées, il est crucial de considérer les deux aspects de la sécurité industrielle pour créer un environnement de travail sûr pour tous les acteurs. C’est sur la base de ce constat, des évolutions techniques, normatives et règlementaires, que le groupe de travail et comité de pilotage Quali-SIL travaille sur le développement de la formation certifiante « Quali-SIL Machine ». Quali-SIL Machine a pour but de répondre à ces questions et apporter des solutions.

Les technologies de l'Intelligence Artificielle (AI) et la Sécurité Fonctionnelle (FS)

Avec des systèmes embarqués, des machines et des procédés industriels de plus en plus complexes, le niveau de risque acceptable dépendra probablement d’une sécurité fonctionnelle intégrant des concepts de sécurité avancés.

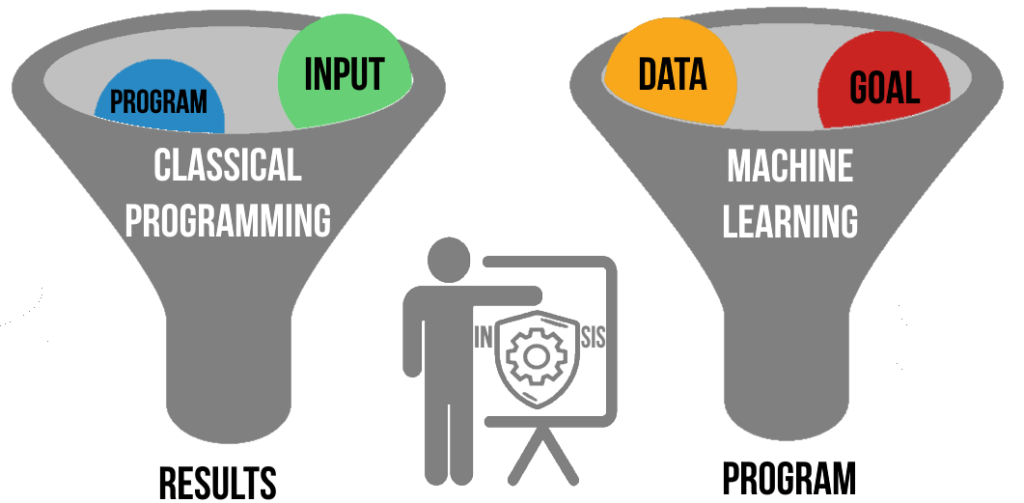

L’IA et le Machine Learning (ML) font parties de ces techniques émergentes qui ouvrent de nouvelles opportunités significatives pour réduire les risques à un niveau acceptable. En s’adaptant de manière autonome, l’IA pourrait rendre les systèmes plus sûrs.

Utilisation de l’IA au sein des systèmes de commande relatifs à la sécurité : boite de Pandore, libérant des forces imprévues et indésirables ou source de bienfaits et de prospérité ?

Le ML a la capacité de renforcer l’intégrité des systèmes critiques en les rendant plus robustes aux aléas des situations qu’ils rencontrent. Toutefois la complexité engendrée par la multiplicité des composants et opérateurs intervenant dans la chaîne d’approvisionnement, l’opacité du processus décisionnel, les biais algorithmiques, les cybermenaces et l’augmentation de la dépendance technologique entrainent des craintes légitimes. Une caractéristique principale de l’IA est sa dépendance aux données. De tels volumes de données entrainent des interrogations sur leurs exactitudes, leurs pertinences ainsi que des problèmes d’éthiques et de protection des données.

Dans les standards industriels matures traitant de la Sécurité Fonctionnelle, l’utilisation de la technologie et des systèmes à base d’IA n’étaient généralement pas envisagés pour réaliser des fonctions de sécurité, voire dans certains cas explicitement interdits. Partant du principe que la spécification, la conception, l’exploitation et la vérification des fonctions critiques doivent être basées sur des méthodes les plus formelles possible, capables de fournir des garanties d’exactitude strictes, les techniques d’IA et de machine Learning sembleraient, de prime abord, inappropriées et inaptes à fournir de telles assurances. Dans certains cas, il s’avère difficile d’expliquer pourquoi elles se comportent d’une manière particulière et de garantir leurs performances. Ce reproche qui pourrait être adressé à l’IA pour son manque de déterminisme, de transparence et de prévisibilité résonne avec les critiques qui étaient autrefois formulées à l’égard des défaillances aléatoires des systèmes à base de processeurs et de leur problématique logicielle, comparativement au relayage.

Alors que certains secteurs ont encore des réticences à faire la transition du câblé au programmé, d’autres ont déjà intégré cette technologie pour réduire les risques. Les algorithmes d’apprentissage automatique et d’apprentissage profond sont capables d’analyser de vastes ensembles de données pour repérer des schémas et des comportements suspects. Ces algorithmes déjà largement utilisés en cyberdéfense (IPS, IDS, sonde réseau, …) peuvent identifier des anomalies potentielles dans les comportements des systèmes, des utilisateurs ou des flux de données. Ils permettent ainsi de prévenir d’une attaque avant qu’elle ne cause des dommages ou qu’elle ne se propage.

Dans le cadre de la Sécurité Fonctionnelle, la pertinence des technologies d’IA lorsqu’elles sont utilisées réside dans leur potentiel à aborder de nouvelles méthodes de réduction des risques et proposer de nouvelles barrières de protection.

Maîtriser les facteurs de risque et les capacités systématiques des fonctions

Actuellement, dans l’évaluation du niveau d’intégrité d’une fonction relative à la sécurité, une distinction est faite entre les défaillances aléatoires du matériel et les défaillances systématiques. Ces dernières déjà prépondérantes, sont destinées à s’amplifier avec l’avènement de l’intelligence artificielle. Il sera nécessaire de porter une attention particulière pour garantir que les capacités systématiques des fonctions soient bien maîtrisées et adaptées à l’environnement d’utilisation prévu. L’utilisation de l’IA dans le cadre de la sécurité fonctionnelle devra s’accompagner d’une analyse des facteurs de risque spécifiques, il faudra notamment clairement identifier et maîtriser :

- le degré de transparence et d’explication des décisions,

- le degré d’autonomie et de contrôle de ces décisions,

- la complexité environnementale, le flou des spécifications et les dérives possibles engendrées par ces imprécisions,

- la résilience aux entrées malveillantes contradictoires et intentionnelles,

- les défaillances matérielles et le degré de maturité technologique des équipements hardware et logiciels utilisés,

- les processus de V&V et les couvertures de test.

En synthèse, l’IA peut apporter des avantages indéniables au sein des fonctions critiques. Sa capacité d’adaptation, sa diversité, son hétérogénéité garantissent qu’elle aura indubitablement un rôle à jouer dans la stratégie de défense en profondeur. Toutefois, son adoption nécessite une approche réfléchie et une collaboration étroite entre les ingénieurs des procédés, automaticiens, experts en sécurité, ingénieurs en IA, ainsi que les régulateurs et législateurs.

En conclusion, garantir l’efficacité et l’intégrité de l’IA dans le cadre de la sécurité fonctionnelle constitue un défi majeur pour pouvoir valider des concepts de sécurité aussi avancés. Toutefois, c’est en surmontant ces défis avec rigueur et innovation que nous pourrons forger un avenir où la sécurité guidera l’innovation.

F. Ciutat – 2024 – fabien.ciutat@insis.fr

Les IIoT dans le contrôle-commande industriel (ICS) et la sécurité fonctionnelle (SCS, SIS)

Aujourd’hui, l’IIoT semble nous ouvrir de nouvelles perspectives en termes de performances, de productivité, de résilience, de flexibilité, de rapidité. Alors, faut-il succomber au chant des sirènes à l’attrait irrésistible ?

IIot (Industrial Internet of Things), de quoi parle-t-on ?

Il s’agit d’équipement de terrain, de capteurs, d’instruments, actionneurs ou pré-actionneurs interconnectés mis en réseau avec des ordinateurs et des applications dites « industrielles », car il faudrait dans un premier temps bien préciser de quelle industrie on parle. Cette connectivité permet la collecte, l’échange et l’analyse de données, facilitant potentiellement des améliorations de la productivité, et d’efficacité, ainsi que d’autres avantages économiques. La première interrogation venant à l’esprit d’un automaticien ou instrumentiste sera : quoi de neuf ?

En effet, l’essence même de la cybernétique et des systèmes de contrôle-commande industriel a été d’utiliser des systèmes en boucle fermée, utilisant les informations du monde physique, du procédé sous contrôle, pour mieux le piloter. L’automatisation, le Contrôle Avancé, la Productive Maintenance, les Systèmes experts, le machine Learning, … n’ont eu de cesse depuis des décennies d’optimiser la performance et l’intégrité des systèmes opérationnels.

La différence est ailleurs, et certainement à l’image d’une entreprise confondant but et nécessité. Les IIots peuvent contribuer à la nécessité de l’entreprise à faire des profits. En ce sens, ce sont des outils de pilotage des procédés, ou de Business Intelligence. Ce pilotage est ici plus stratégique qu’opérationnel, ils apportent un service qui doit faciliter la prise de décision en tenant compte de paramètres exogènes au procédé suivant une approche le plus souvent économique et commerciale.

Les IIoT, Cloud et Big Data sont étroitement liés, gérer des systèmes opérationnels via le Cloud, facilite la modélisation, le suivi des équipements, la création de jumeaux numérique, l’innovation, … . Les IIoT doivent aider à la stratégie industrielle mais la tactique et le pilotage des fonctions opérationnelles doivent rester au niveau terrain, indépendants et intégrés au système opérationnel sous peine de futures déconvenues.

Les objets connectés ont un rôle à jouer, mais encore faut-il correctement définir leur fonction et leur objectif, car dans un contexte de cybersécurité et de sécurité fonctionnelle, il est important de ne pas reproduire les erreurs du passé. Le principe d’Aristote selon lequel « qui peut le plus, peut le moins » doit être compris dans un monde plus contemporain selon l’expression d’Alfred de Musset « Qui peut lécher peut mordre, et qui peut embrasser peut étouffer ». Car même si les autoroutes sont de magnifiques pistes cyclables, il serait imprudent de s’y aventurer en vélo !

En résumé, et concrètement, il est important de dissocier les équipements, capteurs et autres instruments de terrain utilisés à des fonctions opérationnelles souvent critiques des IIot qui couvrent d’autres fonctions et objectifs. En mélangeant les fonctions et en amenant plus de complexité et de surface d’attaque, les IIot pourraient, sans une approche réfléchie, précisément sur le long terme produire l’effet inverse du profit recherché.

F. Ciutat – 2025 – fabien.ciutat@insis.fr

La révolution cybernétique bouleverse les référentiels techniques, économiques et sociaux, amenant le monde réel à fusionner avec le monde virtuel. Plus que jamais, » L’homme et sa sécurité doivent constituer la première préoccupation de toute aventure technologique « .